Nvidia 系列(二):躍入主流

全球資料中心快速過渡到加速運算

本期重點

重新定義電腦的運算能力

成本與能源效率倍數的改善

躍入全球 IT 主流市場

重新定義電腦的運算能力

今天,電腦運算能力的運用已經無所不在,方式非常多種。有時在辦公室,有時在家裡;有時在雲端,有時在終端設備;有時用於訓練、有時用於推論;有時用於縱相擴展,有時用於橫向擴展。

但是,有一個特定的領域,就是「在雲端上的橫向擴展」,不但關係著人工智慧型應用程式的發展,也是決定 Nvidia 是否進入 IT 主流的戰場。

在過去,在雲端上的橫向擴展基本上是依靠 x86 CPU 完成。然而,CPU 本身為通用運算 (general computing) 的目的而設計,用於生成式人工智慧的運算,結果卻差強人意。

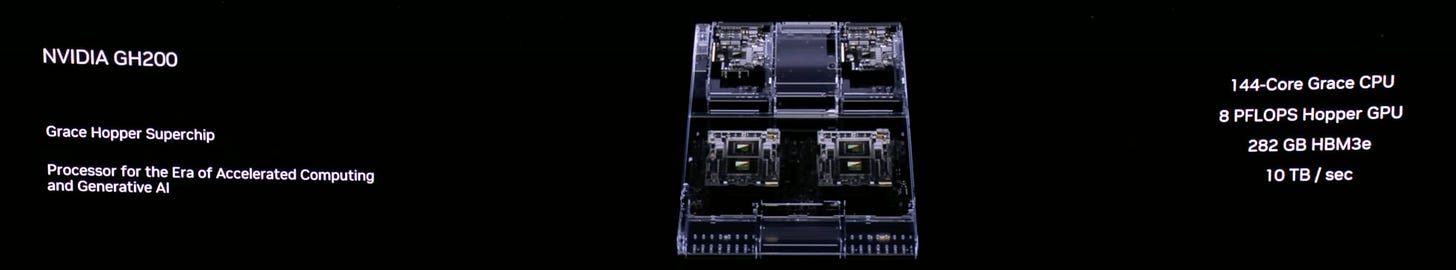

為了迎接生成式人工智慧時代的來臨,除了在幾個月前發布全新的處理器 Grace Hopper 以外,Nvidia 進一步在今年 8月初使用當今最快的記憶體 (HBM3e) 來增強 Grace Hopper 的效能,Nvidia 將它命名為 GH200,預計於今年年底提供樣品,明年第二季度投入生產。

GH200 專門為橫向拓展全球的資料中心而設計,擁有 72 核,透過 CPU 和 GPU 之間高速而且一致的連接 (如一致的高速緩存與記憶體),具有以 Transformer 引擎處理每秒 4 千萬億次浮點運算 (petaFLOPS) 的能力。連接了 HBM3e 之後,GH200 具備每秒 5TB 的 HBM3e 性能。在 Grace Hopper 的結構下,GH200 成為新一代的人工智慧處理器。

每個 GH200 由一個 CPU 和一個 GPU形成一個處理器模組,可以說是一個超級晶片。 如果通過 NVLink 連結二個 GH200,形成一個運算節點,由於 NVLink 在二個處理器模組之間的傳輸速度高達每秒 6TB (terabytes),基本上就將二個超級晶片變成一個超大尺寸的超級晶片,擁有一個巨大的 CPU 和一個巨大的 GPU。

現在,這個 CPU 擁有 144 核,GPU 具有每秒 10 TB 的楨緩衝帶寬 (frame buffer bandwidth) 和 282 GB 的HBM3e,每秒可執行 8 千萬億次浮點運算。開發業者可以將任何的大型語言模型放到其中,進行數量難以想像的推理。

可以想見,在未來,大型語言模型的推理成本將顯著降低,而且可以在全世界各地的資料中心擴展。

圖一 二個 Nvidia GH200 相連後的性能

更進一步,由於伺服器本身容易擴展,只要通過乙太網路或 InfiniBand 網路就可以連接。再透過 NVLink Switch,Nvidia 就可以使 256 個 GPU 同時輸入與輸出,使其猶如一個 GPU 般的工作,構建成 Nvidia DGX GH200 巨型的人工智慧超級電腦系統,形成世界上最大的單一 GPU,擁有 144 TB 的快速記憶,每秒可進行一百億億次 (10的18次方,exaFLOPS) 的浮點運算。

人工智慧超級電腦的運算能力再一次被改寫, 運算能力在雲端上橫向擴展的能力大幅度提升,電腦的運算能力被重新定義。

圖二 透過 NVLink Switch 系統,256 個 GPU 可以同時運作

成本與能源效率倍數的改善

過去人工智慧的前沿模型 (frontier model) 如 GPT-3、 GPT-4 和 Llama 是今天的主流模型。未來在 DGX GH200 這種巨型系統訓練下的前沿模型,將成為未來的主流。一旦成為主流,就會被擴展到各種不同的應用程式,進一步對加速運算形成重大的需求。而除了運算能力的提升之外,形成這種趨勢重大的關鍵,還在於「訓練的成本與能源的功耗」。

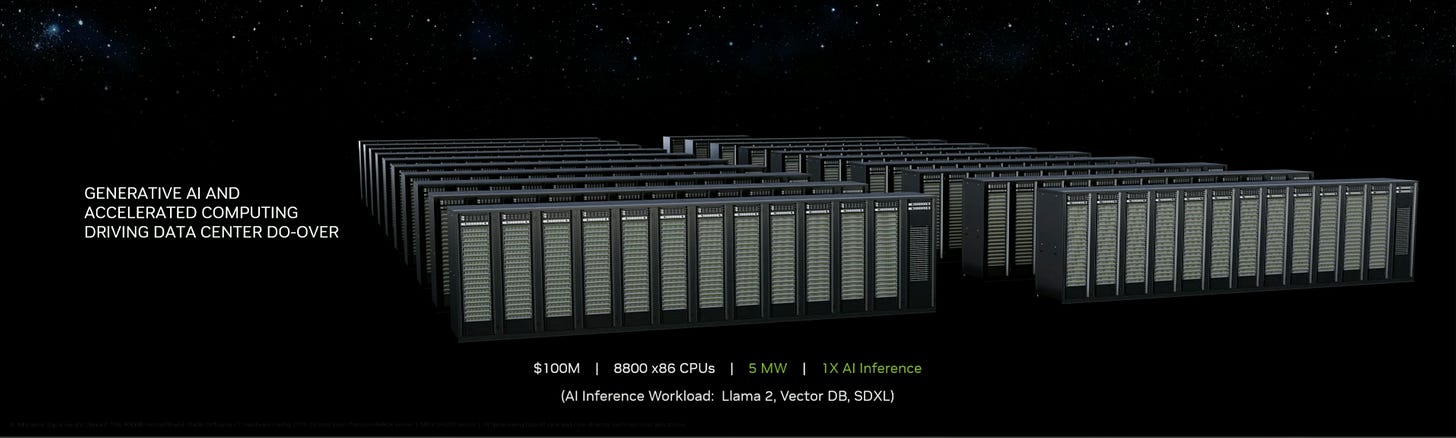

如果以典型的 Llama 2 大型語言模型來看,以一億美元的 ISO 預算,大約可以購買 8,800 個 x86 CPU,功耗為 5 百萬千瓦。如果把這樣的效能標準化為 1 個單位的話:

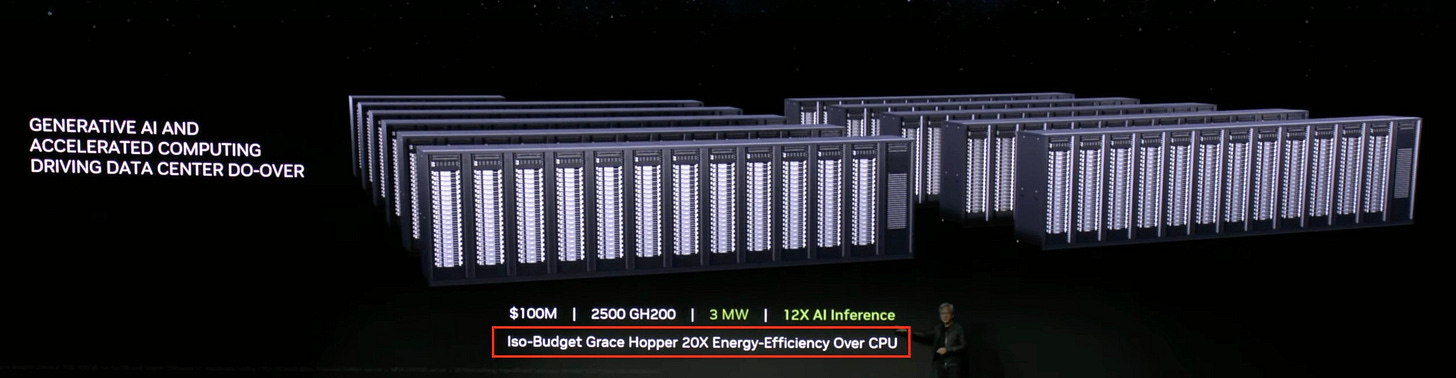

在同樣的預算下,可以購買 2,500 個 GH200,消耗的功耗只要 3 百萬千瓦,吞吐量 (throughput) 增加了 12 倍,能源的效率提升了 20 倍。

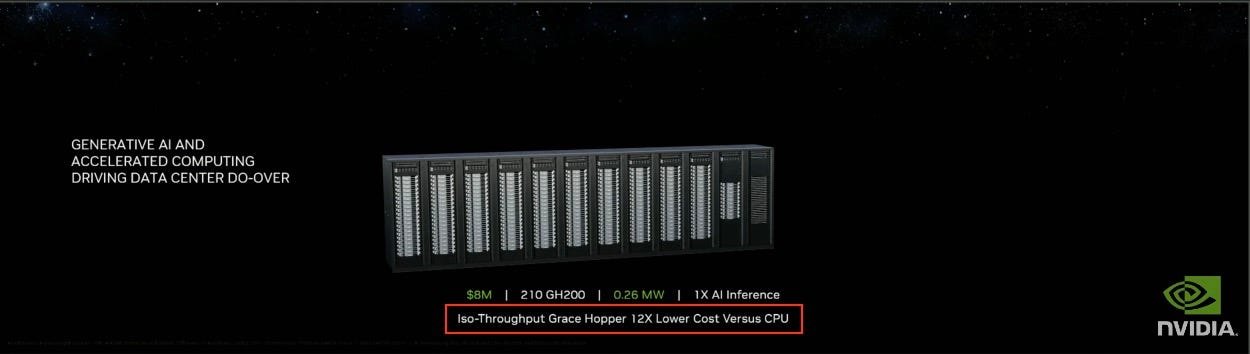

如果以同樣的工作負載來計算,使用 210 個 GH200 就可以達成同樣的吞吐量,成本只要 800 萬美元,而且消耗的功耗只要 0.26 百萬千瓦。同樣的,功耗減少了 20 倍,成本降低了 12 倍。

成本和能源效率以倍數級的方式改善,這是為什麼全球的資料中心將快速過渡到加速運算的基本原因,也是 Nvidia 競爭力的重要來源。

圖三 一億美元 ISO 預算可以購買 8,800 個 x86 CPU,需要 5 兆瓦運行

圖四 同樣的預算,使用 GH200 的能源效率提升了 20 倍

圖五 同樣的工作負載,使用 GH200 的成本降低了 12 倍

躍入全球 IT 主流市場

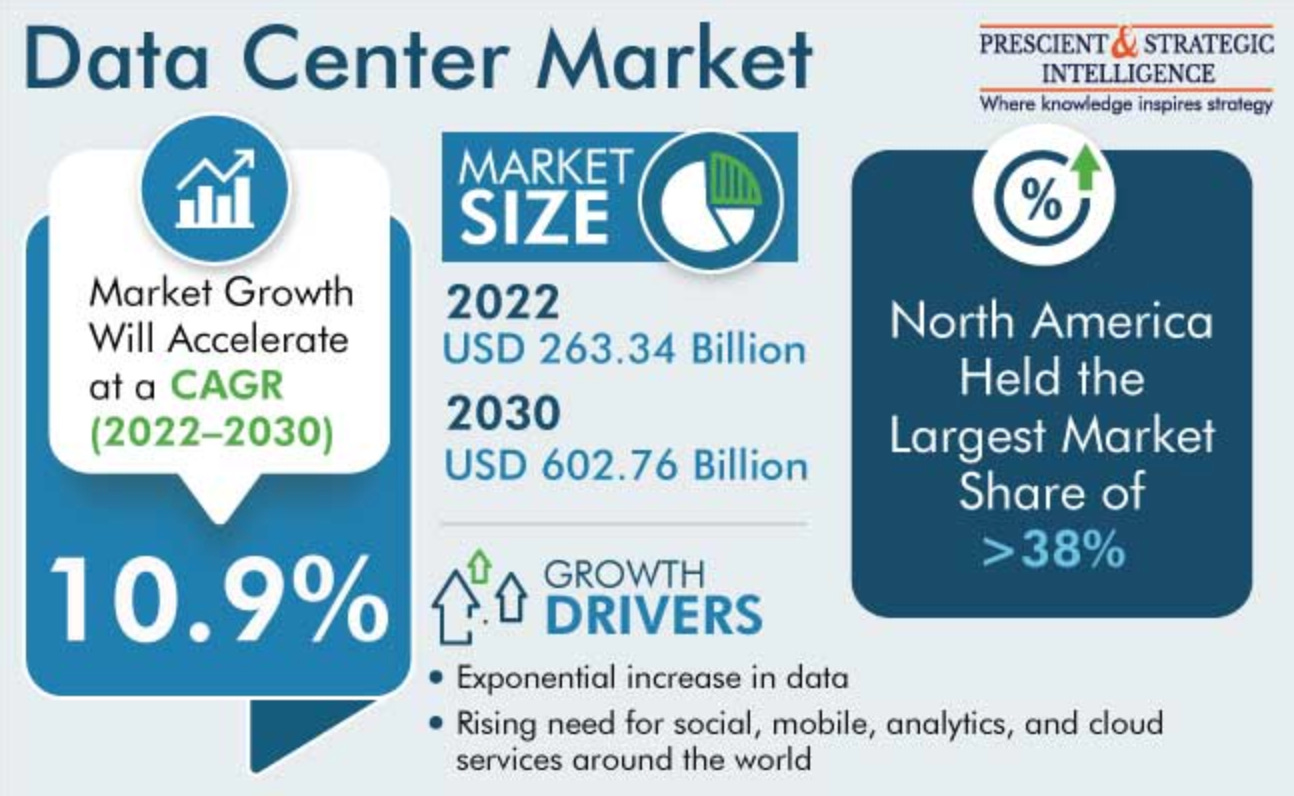

2022 年,全球資料中心的總市場量高達 2,633.4 億美元,而且預計每年以 10.9% 的年複合成長率增長,在 2030 年成長到 6,027.6 億美元。

資料中心不僅是現代高科技的基礎建設,相關的支出也位居全球 IT 預算的主流。

但是,今天資料中心所面臨的成長瓶頸,除了晶片的速度以外,能源的消耗成為最大的限制,許多資料中心因為能源的供應有限而無法進一步擴充。換句話說,誰能解決今天資料中心面臨的兩大問題,就有機會成為資料中心主流晶片的提供者,推動未來人工智慧的發展,而 Nvidia 佔據了行業最佳的發展位置。

圖六 全球資料中心市場規模

2022 年,資料中心晶片的總市場量估計為 200 億美元,僅為整體資料中心市場的一小部份,而 Nvidia 在其中的市場佔有率估計高達 75%。

據估計,Nvidia GPU 的產品訂單已經賣到 2024 年,預計到 2027 年,人工智慧加速晶片的市場將達到 1,500 億美元的規模,到 2033 年恐怕還要再增加一倍。。

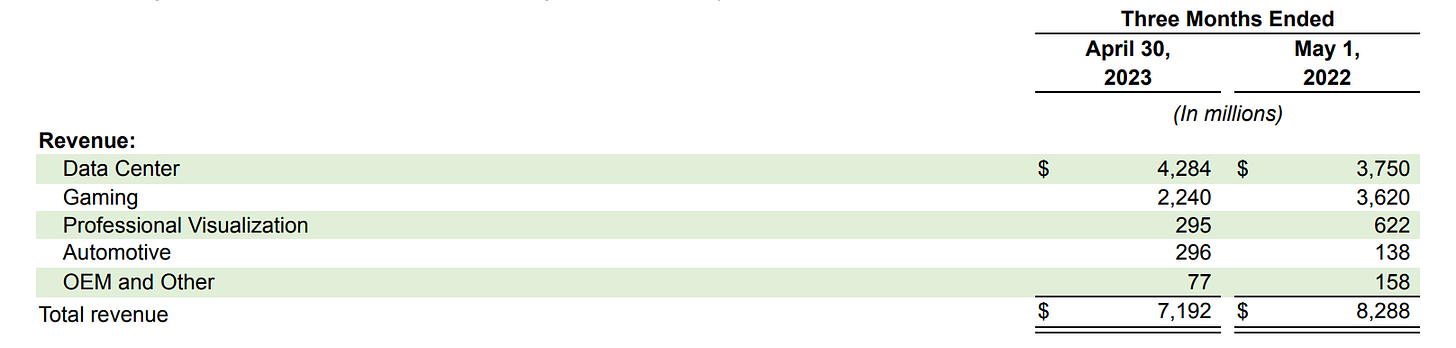

從 Nvidia 公布的第一季財報來看,公司收入雖然較去年同期下降 13.2%,但資料中心晶片的收入在總體經濟環境逆風的情況下,還較去年同期增長 14%,也較上一季度成長 18%,占第一季公司整體收入的 59.6%。資料中心的收入躍居公司主流具有象徵性的意義,也是將 Nvidia 市值推上萬億的重要推手。

公司在 10Q 中揭露,這一切要歸因於生成式人工智慧與大型語言模型大量使用 GPU,來自大型消費互聯網公司與雲服務供應商的需求增加所致。換句話說,

絕大部分資料中心增加的收入都來自於為了要增加或優化人工智慧 (AI-Optimized) 的發展而產生需求。

更有分析指出,Nvidia 資料中心晶片業務有可能在 2024 年創造 750 億至 900 億美元的收入,與目前年化 170 億美元的收入相比,在二年間將出現倍數的增長。

Nvidia 業績的表現將關乎到整個大盤的走勢,如果資料中心的營收能夠超出預期 (目前預估爲 80 億美元),將成為多方力挽狂瀾的關鍵。

圖七 Nvidia 上一季度的收入

《待續》